Africa de Sud a elaborat o lege despre inteligența artificială cu ajutorul inteligenței artificiale, rezultatul fiind halucinații, surse inexistente și o retragere rușinoasă

În luna aprilie a anului 2026, Departamentul sud-african pentru Comunicații și Tehnologii Digitale a dat publicității un document ambițios intitulat Draft National Artificial Intelligence Policy. Acest proiect de politică viza reglementarea domeniului inteligenței artificiale, propunând înființarea a șapte instituții noi, inclusiv o Comisie Națională pentru IA, un Consiliu de Etică și un Fond de Asigurare pentru IA, destinat să compenseze victimele sistemelor autonome. Documentul, aprobat pe 25 martie, părea să deschidă un capitol nou în reglementările tehnologice din Africa, dar a fost retras în mai puțin de două săptămâni.

O investigație realizată de publicația sud-africană News24 a scos la iveală că, din cele 67 de referințe academice citate, cel puțin șase erau fictive. Acestea nu apăreau în nicio bază de date academică recunoscută, fiind evident că articolele respective nu existau. Aceste invenții erau rezultat al unor halucinații generate de inteligența artificială, care, în absența unor surse reale, producea informații plauzibile, dar false.

Ministrul Comunicațiilor și Tehnologiilor Digitale, Solly Malatsi, a reacționat prompt, catalogând incidentul drept un „eșec inacceptabil” care a afectat integritatea documentului. El a promis că vor fi asumate consecințele, dar nu a precizat un termen pentru republicarea unui document corectat.

Cazul din Africa de Sud nu este singular; halucinațiile academice generate de inteligență artificială au fost întâlnite și în cercuri mai restrânse decât cele guvernamentale. Un studiu recent a arătat că 2,6% din articolele academice din 2025 conțineau referințe false, în creștere față de 0,3% în anul precedent, și avocați din diferite țări s-au confruntat cu sancțiuni după ce au prezentat la instanțe citări inventate de AI.

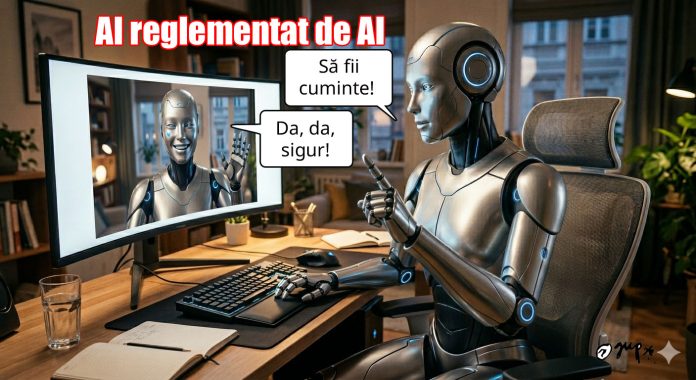

Experții au confirmat că, deși documentul de la Pretoria conținea principii valoroase referitoare la transparență și echitate, acesta nu a putut supraviețui unei simple verificări bibliografice. Ironia situației constă în faptul că instituția menită să reglementeze inteligența artificială a utilizat-o fără o supraveghere umană adecvată, ceea ce a dus la crearea unui document compromis chiar de tehnologia pe care încerca să o reglementeze.

Învățătura principală nu este că instrumentele AI nu pot fi folosite în elaborarea documentelor publice, ci că aceste instrumente nu pot înlocui judecata umană, ci trebuie utilizate doar ca un sprijin pentru aceasta.